Spring, vers une robotique réellement sociale

Date:

Mis à jour le 21/12/2021

Et si des robots pouvaient se charger des tâches répétitives d’accueil du public ? Science-fiction ? Pour l’instant… Certes, il existe déjà à l’heure actuelle des intelligences artificielles capables d’interactions avec l’humain. C’est le cas du robot-phoque d’assistance thérapeutique Paro, utilisé dans le domaine de la santé pour apporter les bénéfices de la zoothérapie auprès de personnes atteintes de troubles cognitifs. Mais ces outils de médiation ont des possibilités rudimentaires, ou nécessitent un contrôle distant par un ingénieur.

« Il leur manque la capacité d’interactions multipersonnes. Si deux personnes parlent entre elles ou leur posent toutes deux une question, les robots actuels sont incapables de comprendre », souligne Xavier Alameda-Pineda, responsable de l’équipe RobotLearn au centre Inria Grenoble Rhône-Alpes.

S’il existe des robots dits "majordomes", qui donnent la météo ou indiquent un chemin, ils ne sont pas en mesure d’effectuer des tâches sociales complexes en autonomie, comme d’accompagner les usagers dans un bâtiment. Pour ce faire, un robot social doit en effet percevoir et distinguer les signaux émis par ses différents interlocuteurs, les comprendre, déterminer s’ils s’adressent bien à lui et y réagir de façon adaptée. Le défi est de taille, car il mobilise de nombreuses aptitudes perceptives et nécessite une capacité d’apprentissage automatique pour garantir l’autonomie dans la prise de décisions.

Pour y apporter une réponse, Xavier Alameda-Pineda, spécialiste de la perception audiovisuelle, s’est associé à sept partenaires à la compétence reconnue dans des domaines complémentaires du sien. Ensemble, ils ont conçu SPRING (Socially Pertinent Robots for Gerontological Healthcare), un projet de 48 mois et 8,3 millions d’euros lauréat du programme européen Horizon 2020 (que le jeune chercheur est chargé de coordonner).

Parmi les partenaires choisis, quatre sont académiques (l’université technique de Prague en République Tchèque, l’université de Trente en Italie, l'université Heriot-Watt d'Édimbourg au Royaume-Uni et l'université Bar-Ilan en Israël).

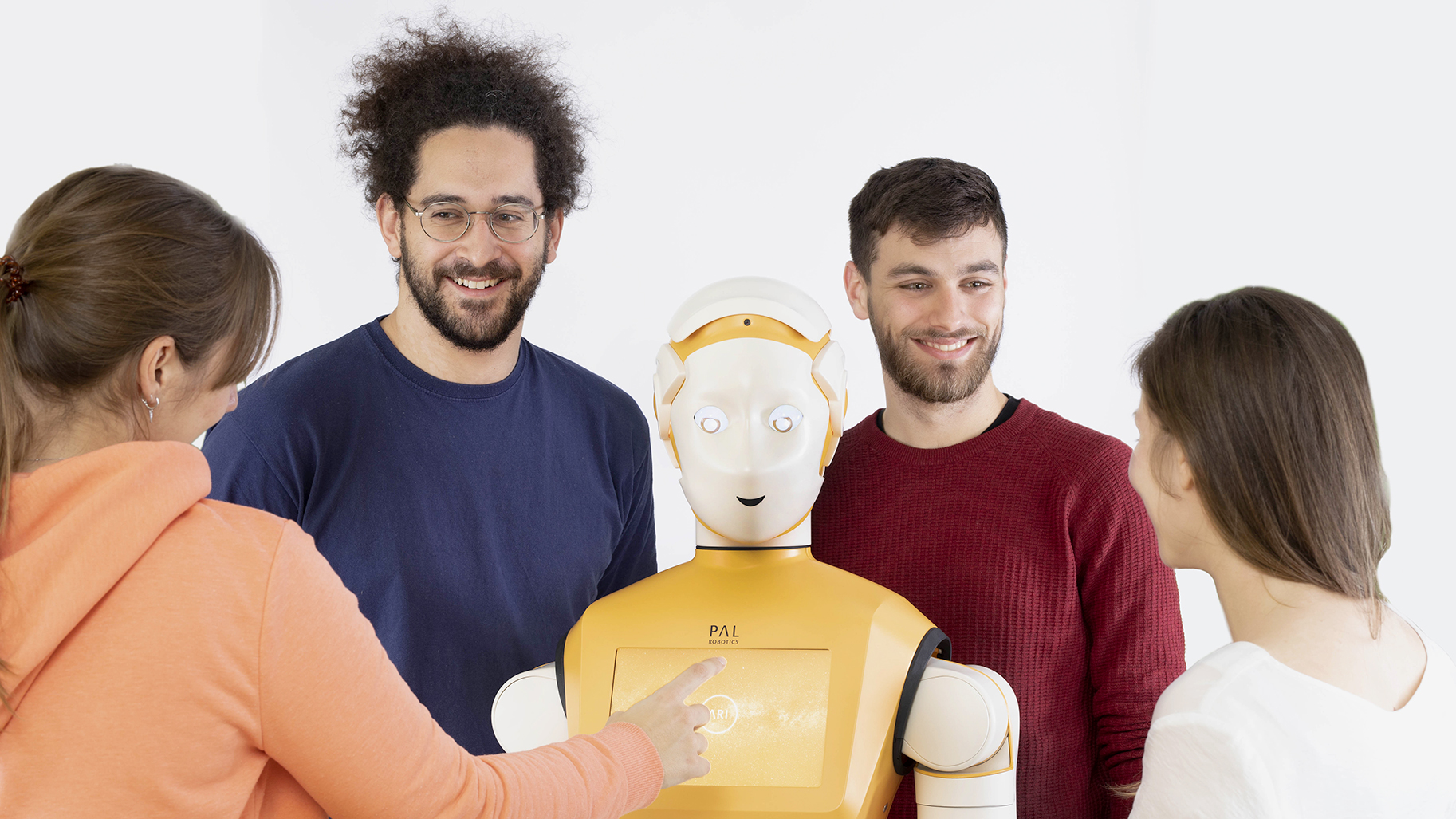

Aux côtés de Robotlearn, ces équipes de recherche ont comme mission de faire évoluer le système de dialogue, de traitement audio, d’analyse du comportement humain et de repérage dans l’espace d’ARI, un robot humanoïde développé par l’un des partenaires technologiques du projet, l’industriel Pal Robotics. ERM Automatismes, l’autre partenaire technologique, est chargé d’intégrer dans les logiciels du robot les différentes avancées des équipes de chercheurs. Enfin, un partenaire hospitalier, l’AP-HP, qui utilise déjà les robots Paro et Nao au sein du Broca Living Lab, fournira à SPRING le cadre des expériences auprès des patients et du personnel soignant.

Mais comment faire en sorte qu’un robot soit en mesure de : distinguer dans un ensemble de conversations une sollicitation qui lui est adressée ; comprendre qu’on lui demande où s’asseoir ; regarder autour de lui pour trouver une chaise libre ; calculer la trajectoire à adopter pour accompagner le solliciteur jusqu’à la chaise, tout en évitant les autres patients et le personnel présents dans les locaux ; être capable de percevoir la pertinence de proposer ensuite une distraction sous forme de conversation ? Les difficultés et verrous technologiques à surmonter pour accomplir ce type de tâche complexe sont nombreux.

Pour le déplacement, la méthode choisie par RobotLearn est celle de l’apprentissage par renforcement. Pour déterminer sa vitesse, son angle d’approche et les autres paramètres de son déplacement, le robot est entraîné grâce à un système d’intelligence artificielle qui calcule l’adéquation entre l’action optimale et celle effectivement entreprise, et attribue des "récompenses" en fonction de la réussite. Cette phase d’entrainement permet de confronter le robot à une grande variété de cas de figure en toute autonomie, sans nécessiter d’intervention humaine pour corriger les trajectoires. Une fois en conditions réelles, ARI continuera à apprendre et à déterminer, pour chaque situation, l’action optimale. Ce qui permet de pouvoir envisager son utilisation en milieu hospitalier.

C’est l’objectif de la seconde phase de SPRING, qui devrait débuter en 2022 : valider l’usage du robot au sein de l’hôpital, évaluer son impact sur les usagers et leurs pratiques, et son acceptabilité. Car confier des tâches sociales, même simples, à un robot n’a rien d’anodin et pose de nombreuses questions éthiques et organisationnelles, sur lesquelles s’est spécifiquement penché Etienne Berger, ingénieur de recherche au Broca Living Lab (voir encadré).

Pour Xavier Alameda-Pineda, une chose en tout cas est claire : « Je ne crois pas qu’il soit atteignable, ni souhaitable, de remplacer l’humain par le robot ». Il s’agit plutôt de penser en termes de complémentarité, et de tirer parti de ce que le robot social peut apporter : sa capacité à effectuer des tâches répétitives avec toujours la même qualité, et une absence de jugement qui peut mettre l’usager en confiance.

Pour encadrer la recherche menée par le consortium de SPRING, un cadré éthique exigeant a été élaboré à partir des recommandations et directives existantes. Approuvé par les autorités compétentes (Comité de Protection des Personnes, CNIL…), il permet d’assurer la protection des personnes impliquées dans les essais à l’hôpital.

En parallèle, Etienne Berger, en charge du suivi de ces questions pour SPRING, mène une étude de terrain pour évaluer l’acceptabilité du robot par les différents acteurs du service (usagers et leurs accompagnants, personnels soignant et administratif) et estimer l’impact organisationnel du robot sur le fonctionnement du service.

Car au-delà de la protection des données personnelles (notamment médicales), ce projet pose des questions en termes de gestion des effets psychosociaux du robot sur les différents acteurs duservice hospitalier (patients et leurs accompagnants, personnels soignant et administratif). Le mot d’ordre selon le chercheur : « anticiper les situations à risque et prendre en compte la vulnérabilité des usagers ». Les premières enquêtes de terrain révèlent chez les futurs utilisateurs un mélange d’attente et d’appréhension, de curiosité, mais également de pragmatisme. L’installation de ces nouvelles "gérontotechnologies" paraît en effet inéluctable.